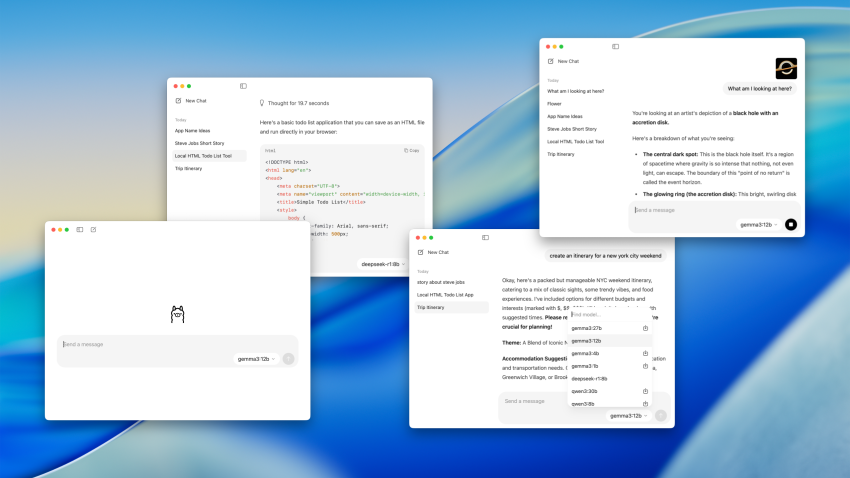

Bulut tabanlı devasa sistemlerin (ChatGPT, Claude gibi) popülerliği malum, ancak her şey internete bağlı olmak zorunda değil. Ollama yerel yapay zeka modellerini kendi bilgisayarınızda çalıştırmanızı sağlayan, adeta bu işin “İsviçre çakısı” diyebileceğimiz bir araç. Verileriniz dışarı çıkmadan, gizlilik endişesi taşımadan ve en önemlisi her ay dolar üzerinden abonelik ödemeden kendi zekanızı yönetebilirsiniz.

Peki, bu sistem nasıl kurulur ve neden her teknoloji meraklısının bilgisayarında bir Ollama olmalı? Gelin, teknik detaylara boğulmadan birlikte bakalım.

Ollama Nedir? Neden Yerel Bir Çözüme İhtiyacınız Var?

Ollama, açık kaynaklı büyük dil modellerini (LLM) yönetmeyi kolaylaştıran bir arayüzdür. Eskiden bu modelleri çalıştırmak için saatlerce kod yazmak, kütüphane indirmek gerekiyordu. Ollama bunu “tek tıkla çalıştır” seviyesine indirdi.

Neden yerel bir sistem kurmalısınız?

-

Gizlilik: Sorularınız ve projeleriniz asla bir şirketin sunucusuna gitmez.

-

Ücretsiz: Kendi elektriğinizi ve donanımınızı kullanırsınız, API ücreti yoktur.

-

Çevrimdışı: İnternet kesilse bile yapay zekanız yanınızda.

Ollama Kurulumu: Adım Adım Başlıyoruz

Kurulum süreci bir program yüklemek kadar basit. İşte izlemeniz gereken yol:

1. Dosyayı İndirin

Ollama’nın kendi sitesine girip işletim sisteminizi (Windows, Mac veya Linux) seçin ve indir butonuna basın. Kurulum bittiğinde, arka planda sessizce çalışmaya başlayacaktır.

2. İlk Modelinizi Uyandırın

Bilgisayarınızın terminalini (Windows’ta PowerShell veya CMD) açın ve şu sihirli cümleyi yazın:

ollama run llama3

Bu komutla birlikte sistem, Meta’nın geliştirdiği en güncel modellerden birini indirmeye başlar. İndirme bittiği an, terminal üzerinden yapay zekayla sohbet etmeye başlayabilirsiniz.

Not: > İlk indirme işlemi modelin boyutuna göre (yaklaşık 4.7 GB) internet hızınıza bağlı olarak biraz sürebilir. Bir kez indikten sonra her şey ışık hızında gerçekleşir.

Hangi Modeli Seçmelisiniz? (Küçük Bir Kıyaslama)

Bilgisayarınızın gücüne göre seçebileceğiniz pek çok model var. İşte en popülerleri:

| Model | Ne İçin Kullanılır? | Önerilen RAM |

| Llama 3 (8B) | Genel sohbet, günlük işler | 8 GB ve üzeri |

| Mistral | Mantık soruları ve yaratıcı yazım | 8 GB |

| Phi-3 | Hızlı yanıt ve düşük güç tüketimi | 4 GB (Eski laptoplar için ideal) |

| CodeLlama | Sadece yazılım ve kodlama | 16 GB |

Donanım Hakkında Gerçekler: Bilgisayarım Kaldırır mı?

Yapay zeka modelleri işlemciden (CPU) ziyade ekran kartını (GPU) sever.

-

Ekran Kartınız Varsa: NVIDIA RTX serisi bir kartınız varsa modeller yağ gibi akar.

-

Mac Kullanıcıları: M1, M2 veya M3 işlemcili bir Mac kullanıyorsanız, Ollama bu cihazların gücünü harika kullanıyor.

-

Sadece İşlemci: Eğer ekran kartınız yoksa üzülmeyin, Ollama yine çalışır. Sadece cevaplar bir tık daha yavaş gelir (dakikada birkaç cümle gibi).

Veri Gizliliği: En Büyük Avantajınız

Çoğu insan farkında değil ama bulut servislerine yazdığınız her şey o şirketlerin eğitim havuzuna gidiyor. Ollama kullanırken ise her şey sizin diskinizde. Şirket sırları, kişisel günlükler veya özel yazılım projeleri üzerinde çalışırken yerel yapay zeka kullanmak gerçek bir güvenlik kalkanıdır.

Sık Sorulan Sorular

Ollama’yı kullanmak için yazılımcı mı olmak lazım?

Hayır. Sadece bir komut satırına ollama run yazabiliyorsanız, bu teknolojiyi kullanmaya hazırsınız demektir.

Bilgisayarım çok ısınıyor, normal mi?

Evet, yapay zeka modelleri çalışırken donanımı tam kapasite kullanır. Model çalışırken fan sesinin artması oldukça normal bir durumdur.

Türkçe dil desteği var mı?

Evet! Özellikle Llama 3 ve Mistral gibi güncel modeller Türkçeyi gayet güzel anlıyor ve konuşuyor.

Kendi dosyalarımı nasıl analiz ettirebilirim?

Ollama’yı tek başına terminalde kullanmak yerine, yanına “Open WebUI” gibi görsel araçlar kurarak PDF veya dokümanlarınızı sisteme yükleyip soru sorabilirsiniz.

Tamamen ücretsiz olduğuna emin miyiz?

Kesinlikle. Ollama bir araçtır, modeller ise açık kaynaklıdır. Hiçbir aşamada kredi kartı bilgisi girmeniz gerekmez.